人工智能技術賦能語言學 在計算機軟硬件平臺的融合與革新

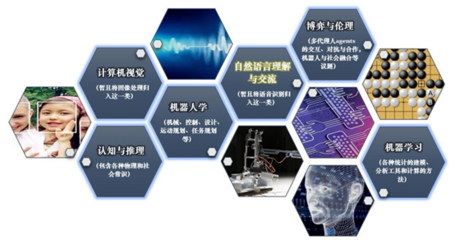

人工智能(AI)技術的飛速發展,正以前所未有的廣度和深度滲透到各個學科領域,語言學便是其中受益顯著且變革深刻的一個。作為研究人類語言本質、結構、演化及使用規律的科學,語言學與AI的結合,不僅為語言學研究本身提供了強大的分析工具和全新范式,同時也深度依賴于并持續推動著底層計算機軟硬件技術的演進。這種雙向驅動的關系,正在重塑我們理解、處理乃至創造語言的方式。

一、軟件層面:算法與模型的革命

在軟件層面,AI技術,特別是機器學習和深度學習,為語言學帶來了方法論上的根本性變革。

- 自然語言處理(NLP)的核心突破:NLP是AI與語言學交叉最直接、最活躍的領域。基于深度神經網絡的語言模型(如BERT、GPT系列、T5等),通過在海量文本數據上進行預訓練,能夠以前所未有的精度理解和生成人類語言。這些模型不僅能夠執行詞性標注、句法分析、語義角色標注等傳統語言學分析任務,更在機器翻譯、文本摘要、情感分析、問答系統等應用層面取得了接近甚至超越人類水平的性能。這背后是算法架構(如Transformer)的革新,使得模型能夠有效捕捉長距離的語義依賴關系。

- 計算語言學的深化:AI為計算語言學提供了強大的分析引擎。研究人員可以利用AI模型自動分析大規模語料庫,發現語言演變規律、方言差異、社會語言學特征等。例如,通過詞向量模型,可以量化詞語之間的語義關系;通過主題模型,可以從海量文檔中自動提取主題結構。這些“數據驅動”的方法,與傳統“規則驅動”的語言學理論形成互補,催生了新的研究問題與發現。

- 語言資源的智能化構建:詞典編纂、語法庫建設、樹庫標注等基礎語言資源建設工作,正越來越多地引入AI輔助。自動標注、校對、一致性檢查等工具大大提升了資源構建的效率和質量,使得更大規模、更精細標注的語言資源成為可能,進而又為更強大的AI模型訓練提供了“燃料”。

二、硬件層面:算力與專用芯片的支撐

AI在語言學領域的應用,尤其是大規模語言模型的訓練與部署,對計算機硬件提出了極高要求,也反過來推動了硬件技術的發展。

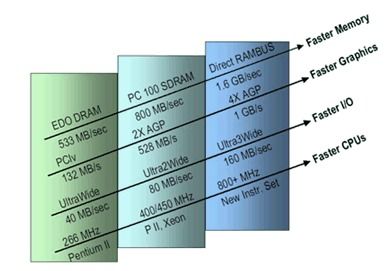

- 通用算力的基石:GPU與云計算:現代大型語言模型的訓練需要處理萬億級別的參數和千億級別的token數據,這離不開圖形處理器(GPU)提供的強大并行計算能力。以英偉達(NVIDIA)為代表的GPU廠商,其產品已成為AI計算的行業標準。云計算平臺(如AWS、Google Cloud、Azure)提供了彈性、可擴展的算力資源,使得研究機構和企業無需自建超算中心,就能訪問頂尖的硬件設施進行模型訓練和推理,極大降低了AI語言技術的應用門檻。

- 專用硬件的演進:TPU與AI芯片:為滿足AI計算特定需求,專用硬件應運而生。谷歌的張量處理單元(TPU)專門針對神經網絡中的矩陣運算進行了優化,在能效和速度上相比通用GPU更具優勢。國內外眾多芯片公司也紛紛研發針對AI訓練和推理的專用芯片(ASIC),旨在為包括NLP在內的AI任務提供更高效、更低功耗的硬件解決方案。這些專用硬件的發展,是支撐未來更龐大、更復雜語言模型的關鍵。

- 邊緣計算的興起:隨著模型壓縮、知識蒸餾、量化等技術的發展,部分AI語言模型(如用于語音識別、實時翻譯的模型)得以在智能手機、物聯網設備等邊緣端運行。這對終端設備的硬件(如移動端SoC中的NPU)提出了新的要求,推動了低功耗、高性能邊緣AI芯片的發展,使得語言智能應用能夠“無處不在”。

三、軟硬件協同下的應用前景與挑戰

軟硬件的協同創新,正在開啟語言學與AI應用的廣闊前景,同時也伴生著挑戰。

- 前景:更強大的多模態理解與生成(融合文本、語音、視覺)、個性化的語言交互助手、無障礙的實時跨語言溝通、對瀕危語言的數字化保存與活化、以及深度輔助語言教學與研究等,都將成為現實。

- 挑戰:從技術角度看,模型的能耗與碳足跡、偏見與公平性問題、可解釋性不足(“黑箱”問題)以及高質量多語言數據的稀缺,是亟待解決的難題。從硬件角度看,如何設計出更高效、更適應稀疏化或新型神經網絡架構的芯片,是持續突破算力瓶頸的關鍵。算力集中化帶來的資源壟斷風險,以及AI生成內容帶來的倫理與法律問題(如版權、虛假信息),也需要學術界、產業界和監管機構共同應對。

結論

人工智能技術在語言學領域的應用,是一場由先進算法模型(軟件)和強大計算硬件共同驅動的深刻變革。軟件層面的模型創新不斷提出更高的算力需求,而硬件層面的每一次躍升又為更復雜、更智能的語言AI應用鋪平道路。二者如鳥之雙翼、車之兩輪,共同將語言學研究推向了“大數據+大算力+大模型”的新時代。隨著軟硬件技術的持續迭代與深度融合,人工智能不僅將繼續作為語言學研究的強大工具,更可能幫助我們揭示人類語言更深層次的奧秘,并創造出前所未有的語言智能形態。

如若轉載,請注明出處:http://m.ynanbang.cn/product/40.html

更新時間:2026-02-24 01:03:45